5G网络助力XR(三)-@面向VR敏感时延的缓存管理-杨军超博士

2021-01-13

1. 引言

在VR系统中,VR的延迟特指MTP(motion-to-photon)延迟,它描述从用户运动开始到相应画面显示到屏幕所花的时间,其中包括运动传感器的延迟,网络的延迟,渲染的延迟和显示的延迟四个主要的因素。根据最新的研究称,能够保证高质量VR体验的最小的延迟范围在17-20ms之间,MTP延迟无疑是除了高码率之外的另一个影响VR体验质量的最重要因素,如果延迟大于20ms,很容易产生晕动症(motion sickness),从而导致坏的VR体验,大部分HMD厂商都宣称其设备能够支持20ms以内的延迟[1],但是除非网络延迟的量级能够达到数毫秒(据报道,我国目前80%的网络延迟达到90毫秒以上),否则把整个360度全景视频发送到HMD以降低网络的延迟会一直是一个迫不得已的选择。

由于VR交互性的特性,其对于延迟的要求相对于传统视频而言更为苛刻,而目前主流的4K 质量的虚拟现实视频至少需要每秒数百兆比特的传输速率,并且又要同时保证用户交互体验,当前VR的内容主要是本地内容播放或者有线的内容传输为主,一定程度限制了VR的应用场景。目前VR视频传输仅能满足用户基本的VR体验,距离随时随地高质量的VR体验的行业应用需求依然存在巨大的差距,解决基于5G网络VR内容的实时无线传输是解决此困境的关键,然而无线网络的不稳定性以及易错性需要根据用户不同的网络状况合理的进行缓存(prefetching),在保证用户视频质量的同时保证VR用户流畅的交互体验。

与传统视频相比,对VR内容进行缓存更有挑战和难度。一方面,基于用户头部运动轨迹的视点预测随着时间预测准确性下降明显,提高了提前缓存视频内容的难度。另外一方面目前大部分VR视频平台依旧延用传统视频的传输机制,一定程度上会降低VR的交互式体验,因此针对VR延迟要求,更为准确的视点预测方法和缓存机制是提供更高质量的VR体验的迫切需求。

图1 当前VR内容有线传输示意图

2. 基于两级缓存的VR内容自适应传输策略

对于延迟敏感的VR应用,用户缓存能够提供流畅的用户体验,但是在用户带宽状况较好的情况下缓存较长时间低质量的视频块,会出现缓存溢出的情况;而在带宽情况较差的情况下缓存较短时间高质量的视频块则出现视频块无法及时完成下载,导致卡顿现象,这两种情况都会降低用户的体验。因此,在视点预测的基础上,我们提出一种基于两级缓存的自适应传输算法,综合考虑用户的带宽状况、用户视点预测以及缓存区的状态进行自适应传输。

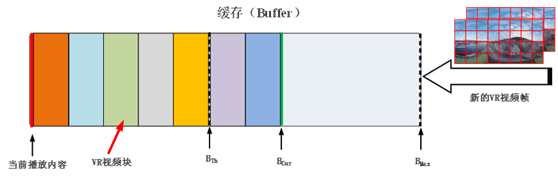

图2 5G场景下VR确定时延的缓存管理策略

具体地,用户的带宽状况采用机器学习的方法利用上一个时间段的带宽状况对下一个时间段的带宽进行预测,服务器记录用户视点的轨迹,并基于历史的运动轨迹和相似用户的视点轨迹进行视点预测,并将视点预测的结果及时反馈给用户终端的自适应决策模块。用户终端缓存区缓存策略采用两级缓存策略,将整个缓存区划分成两个区域,即[0, ]和[ , ],其中, 和 分别表示两级的门限值以及最大的缓存值。其中,[0, ]为第一级的缓存区,当用户当前的缓存状态 小于 时,意味着缓存中的内容将很快被消耗,如果不及时下载新的视频块则会出现卡顿的现象,需要及时的请求更多的视频块,以满足用户的需要。

基于两级缓存管理采用的策略是基于用户视点预测的结果更新[0, ]部分的Tile,即带来更大效用值增益的Tile传输更高质量的版本;下载[ , ]部分的视频块,通过下载该部分的视频块及时达到缓存区门限值 。对于此部分的下载任务来讲,主要通过视频块内Tile码率的选择达到总体缓存区内效用值的最优,当用户当前的缓存状态 大于 时,意味着缓存区有足够的视频块供用户观看,因此,采用更新[0, ]部分的Tile;下载[ , ]部分的视频块,由于在下载此部分的视频块时,用户视点的预测准确性较低,基于视点预测的Tile选择存在很大的偏差,可以采用统一的最低的码率版本进行下载[ , ]部分的视频块。一方面,当缓存区的内容快要被消耗完时,需要采取保守策略的更新缓存区的Tile和下载新的视频块,另外一方面,当缓存区快要达到最大缓存值时,需要采取更激进的策略更新缓存区的Tile和下载新的视频块。因此,请求下载的速率 需要综合当前缓存区的状态以及预测的带宽决定。

3. 结束语

针对时延敏感的VR应用,基于两级缓存策略,我们提出一种综合带宽状况、缓存区状态的自适应算法,与传统缓存机制的缓存机制相比,所提自适应算法在带宽变化频繁的情况,能够保证更好的VR用户QoE。

参考文献:

[1]A. TaghaviNasrabadi, A. Mahzari, J. D. Beshay, et al. Adaptive 360-degree video streaming using layered video coding[C]//2017 IEEE Virtual Reality (VR). Los Angeles, USA, IEEE, 2017: 347-348.

[2]R. Guntur, W. T. Ooi. On tile assignment for region-of-interest video streaming in a wireless LAN[C]. 22nd Internatial Workshop Networking Operating Systtem Support Digital Audio Video. Toronto, Canada, 2012: 59-64.

[3]T. Alshawi, Z. Long, G. Alregib. Understanding spatial correlation in eye-fixation maps for visual attention in videos[C]// IEEE International Conference on Multimedia and Expo. Seattle, USA, IEEE, 2016: 1-6.

[4]Q. Zhao, L. Wan, W. Feng, J. Zhang, T.T. Wong. Cube2video: Navigate between cubic panoramas in real-time[J], IEEE Trans. Multimedia, 2013,15(8):1745-1754

[5]C. Ozcinar, A. De Abreu, A. Smolic Viewport-aware adaptive 360 video streaming using tiles for virtual reality[C]//2017 IEEE International Conference on Image Processing (ICIP). Beijing, China, IEEE, 2017: 2174-2178.

[6]J. D. Praeter, P. Duchi, G. Wallendael, J. Macq, P. Lambert. Efficient encoding of interactive personalized views extracted from immersive video content[C]. ACM 1st International Workshop on Multimedia Alternate Realities. Amsterdam, Netherlands, 2016: 25-30.

[7]L. Xie, Z. Xu, Y. Ban, X. Zhang, Z. Guo, 360probdash: Improving qoe of 360 video streaming using tile-based http adaptive streaming[C]//Proceedings of the 25th ACM international conference on Multimedia. Mountain View, California, USA, ACM, 2017: 315-323.

[8]F. Qian, L. Ji, B. Han, V. Gopalakrishnan, Optimizing 360 video delivery over cellular networks[C]//Proceedings of the 5th Workshop on All Things Cellular: Operations, Applications and Challenges. New York City, New York, ACM, 2016: 1-6.

[9]R. Skupin, Y. Sanchez, D. Podborski. HEVC tile based streaming to head mounted displays[C]// Consumer Communications & NETWORKING Conference. New York City, New York, IEEE, 2017: 613-615.

[10]L. Xie, X. Zhang, Z. Guo Cls: A cross-user learning based system for improving qoe in 360-degree video adaptive streaming[C]//2018 ACM Multimedia Conference on Multimedia Conference. Seoul, Korea, ACM, 2018: 564-572.