基于神经网络的图像增强-姚卫博士

2021-07-06

由于人脑具有大规模并行存储与处理、高智能逻辑推理、自学习等功能,人们希望将人脑的功能应用于计算机,使其具有人脑般的逻辑推理、自学习等能力。人工智能是一门研究与开发用于模拟和延伸人的智能的理论、方法、技术以及应用系统的新科学。人工智能技术与纳米技术、基因工程并称为二十一世纪三大尖端技术。人工智能的目的就是要使机器能够胜任一些需要人类智能才能完成的复杂工作,如语音识别、自然语言处理、机器人等。而这些人工智能技术一般通过神经网络来实现。神经网络可以对任意的连续函数进行无限逼近,这也是学者们认为其在人工智能中起重要作用的主要原因。目前,人工智能的研究已经越来越深入,神经网络的作用也日益突出。

人工神经网络是从生物神经网络的结构出发,对其一些基本特性进行数学上的抽象和模拟,并用于探索人脑智能行为的仿生模型。人工神经网络的出现与发展与计算机科学、人工智能、神经科学等密切相关。目前,人工神经网络在模式识别、信息处理、逻辑运算、图像处理等实际应用领域取得了一些成就。因此,有关人工神经网络的研究逐渐成为热点课题,并得到了大量学者的关注。

为了在保持优良降噪性能的前提下,保护图像的边缘信息,刘与许两位学者提出了基于神经网络和双密度双树小波的图像降噪与增强算法[1]。利用卷积神经网络(convolutional neural networks, CNN)识别图像的边缘,对非边缘区域进行降噪处理,同时保留边缘区域的信息。在降噪过程中,采用双密度双树DWT对噪声图像进行降噪处理,再训练神经网络来降低噪声图像和原图像的均方误差,从而对图像进行增强。

1. 基于人工神经网络的图像增强

通过人工神经网络(artificial neural network, ANN)对图像进行增强,ANN的结构包括输入层、隐藏层和输出层,隐藏层为10个神经元。降噪的非边缘区域和保留的边缘区域作为ANN的输入,ANN输出增强的图像。隐藏层神经元的激活函数为sigmoid函数。

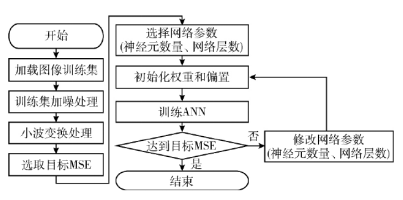

图1是ANN训练的流程。小波降噪的输出图像作为神经网络的输入,训练过程中固定神经元的数量、权重偏置和隐层数量。

图1 ANN训练的流程

2.实验结果

测试图像为两个512×512的8比特灰度图像和两个256×256的8比特灰度图像。Lena图像和Man图像为512×512,Cameraman图像和Peppers图像为256×256。采用标准偏差分别为{10,20,30,50,70}的加性高斯白噪声对每个图像分别进行处理,获得不同级别的噪声图像。

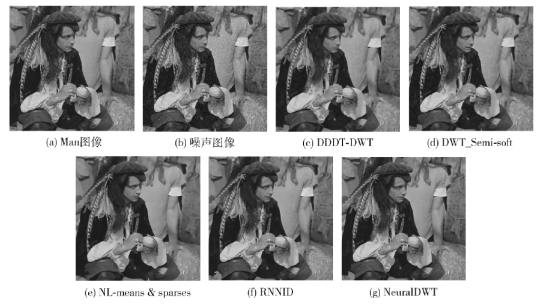

首先评价图像降噪技术的视觉效果,Man图像中同时包含了高纹理区域和平滑区域,因此采用Man图像作为视觉效果的benchmark图像,结果如图2所示,其中噪声图像被添加了标准偏差=20、均值=0的高斯白噪声。图中的降噪算法均获得了满足需要的视觉效果。刘与许两位学者提出的算法(NeuralDWT)在空间域将噪声图像分割成边缘区域和非边缘区域,对非边缘区域采用双密度双树小波变换进行降噪,在保留的边缘区域和降噪的非边缘区域输入神经网络进行增强处理。该算法获得了较好的降噪效果,并且在高纹理区域 (图中人物的帽子、头发等位置)的细节也略好于其它降噪方法。

图2 Man图像的降噪结果